Jensen Huang pokazał architekturę NVIDIA Rubin na CES 2026. Możliwości są spektakularne i niszczą Blackwella

Wszyscy spodziewali się, że Jensen Huang zachowa swoje asy w rękawie na marcową konferencję GTC, ale szef NVIDIA postanowił zagrać va banque już teraz. Na targach CES 2026, zamiast kurtuazyjnych zapowiedzi, dostaliśmy technologiczną bombę wodorową. Platforma Vera Rubin została oficjalnie zaprezentowana i jest absurdalnie potężna.

Decyzja o przyspieszeniu prezentacji to jasny sygnał dla rynku: wyścig zbrojeń w dziedzinie sztucznej inteligencji nie zwalnia ani na moment, a NVIDIA nie zamierza oddać nawet centymetra pola konkurencji. Platforma Rubin to nie ewolucja, to skok na głęboką wodę, który sprawia, że dotychczasowe superkomputery wyglądają jak zabawki. Mówimy tu o systemie, który w pełni wykorzystuje pamięci HBM4 i autorskie rdzenie procesora, oferując wydajność, od której kręci się w głowie.

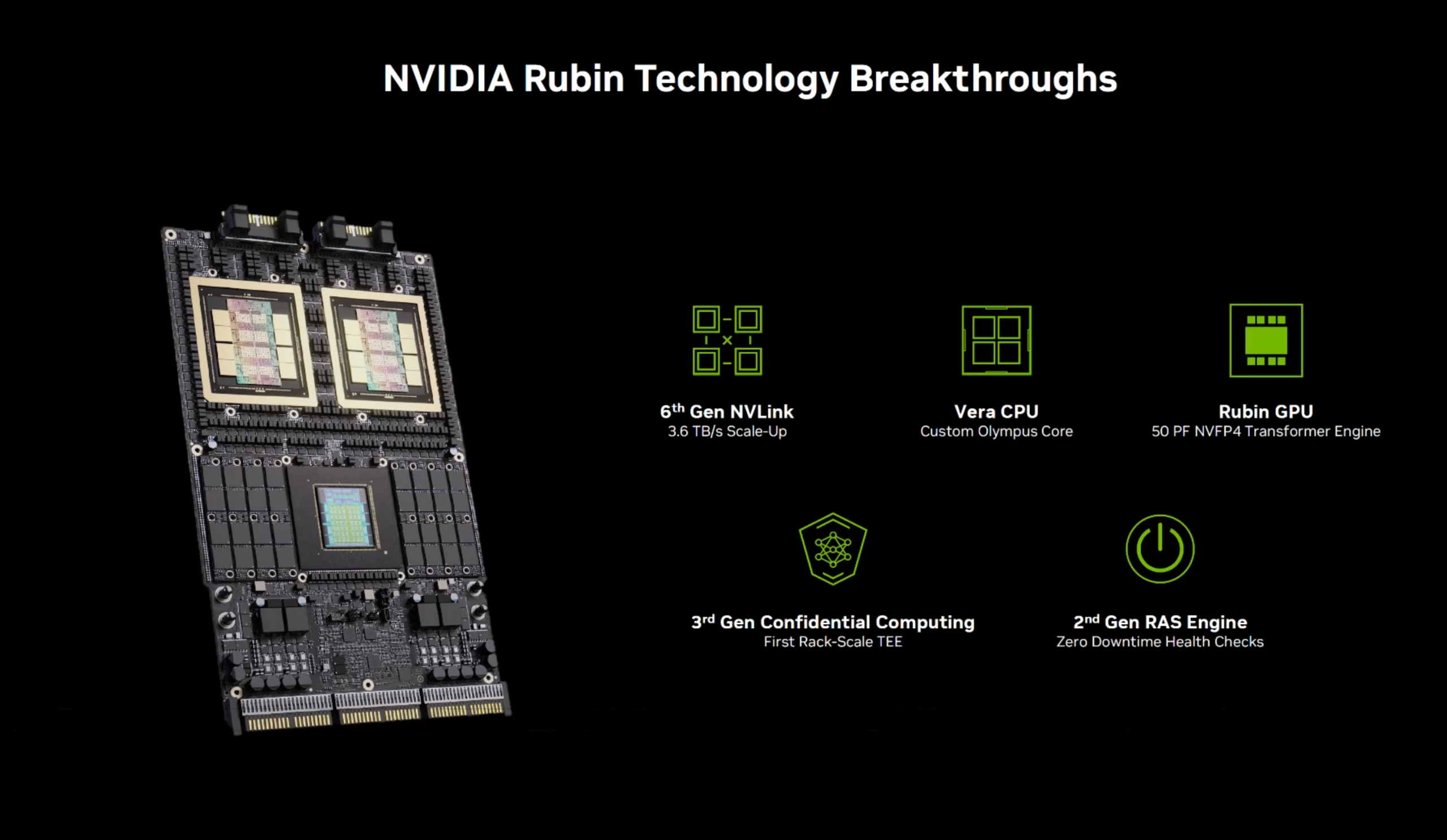

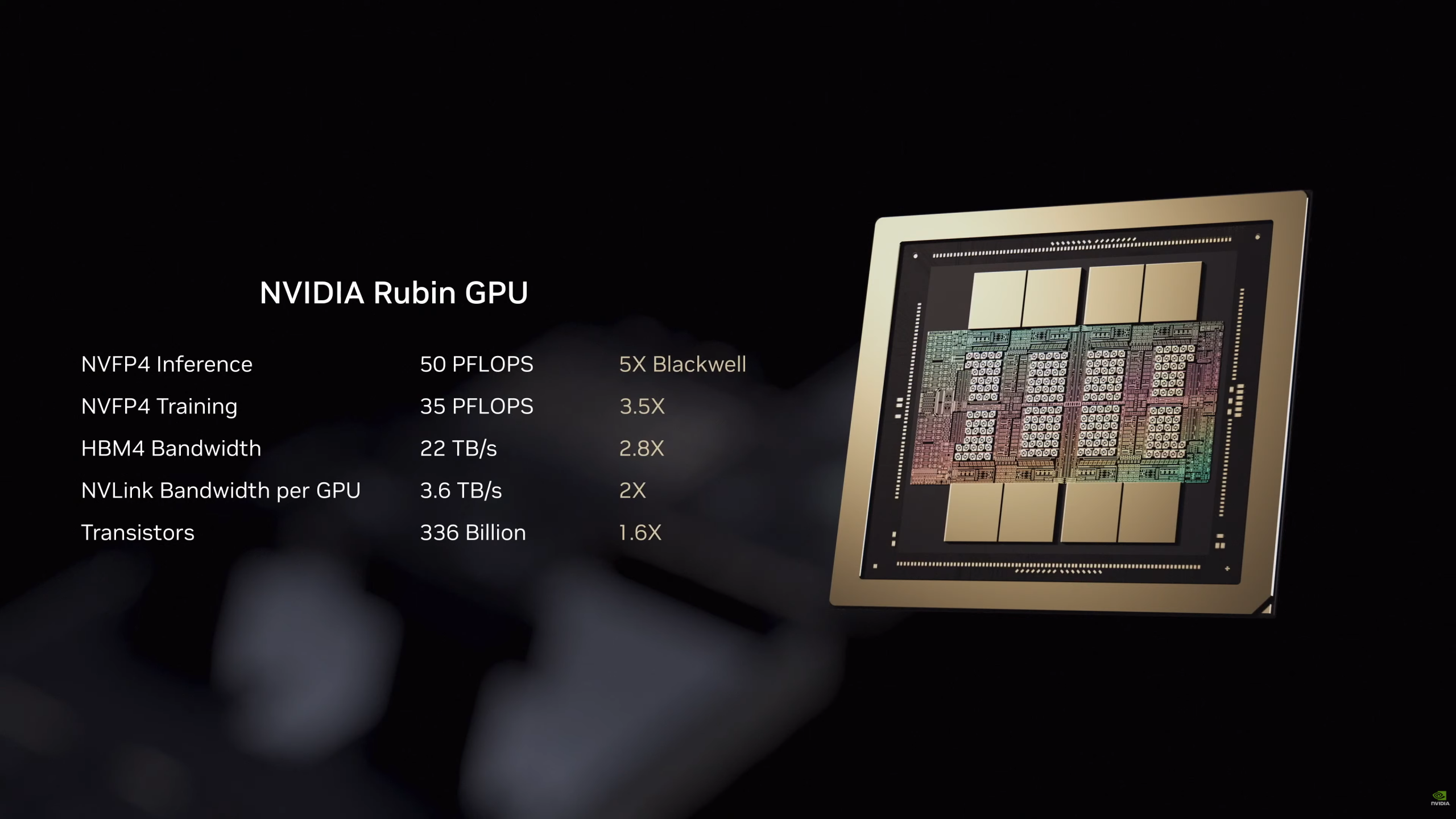

Sercem nowej platformy jest Rubin GPU. Ten krzemowy potwór, wyposażony w 336 miliardów tranzystorów, został zaprojektowany z myślą o jednym celu: absolutnej dominacji w obliczeniach AI. Dzięki zastosowaniu pamięci HBM4, przepustowość sięga niewiarygodnych 22 TB/s na układ, co stanowi niemal trzykrotny wzrost względem poprzedniej generacji. W zadaniach wymagających zawrotnego wnioskowania, Rubin osiąga 50 PFLOPS (przy precyzji NVFP4), co oznacza pięciokrotny skok w porównaniu do układów Blackwell.

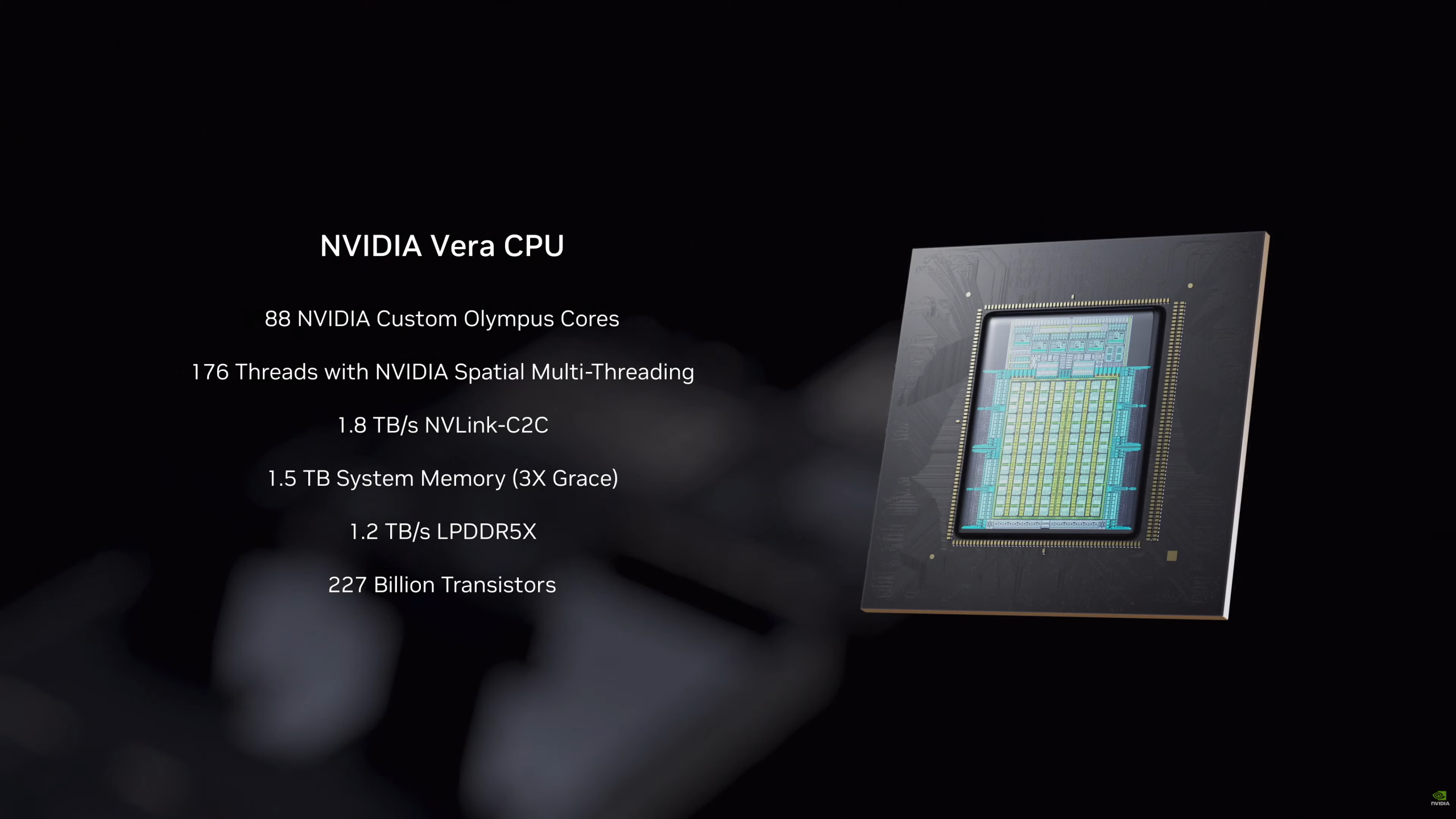

Ale GPU to tylko część układanki. Do gry wchodzi również Vera CPU - procesor oparty na 88 autorskich rdzeniach "Olympus" (architektura ARM). NVIDIA ostatecznie udowadnia, że potrafi robić nie tylko grafiki, ale i kompletne ekosystemy obliczeniowe. Vera oferuje dwukrotnie wyższą wydajność przetwarzania danych niż jej poprzednik, Grace, i wspiera aż 1,5 TB pamięci LPDDR5x. To "mózg", który ma karmić "mięśnie" Rubina danymi w tempie, jakiego świat jeszcze nie widział.

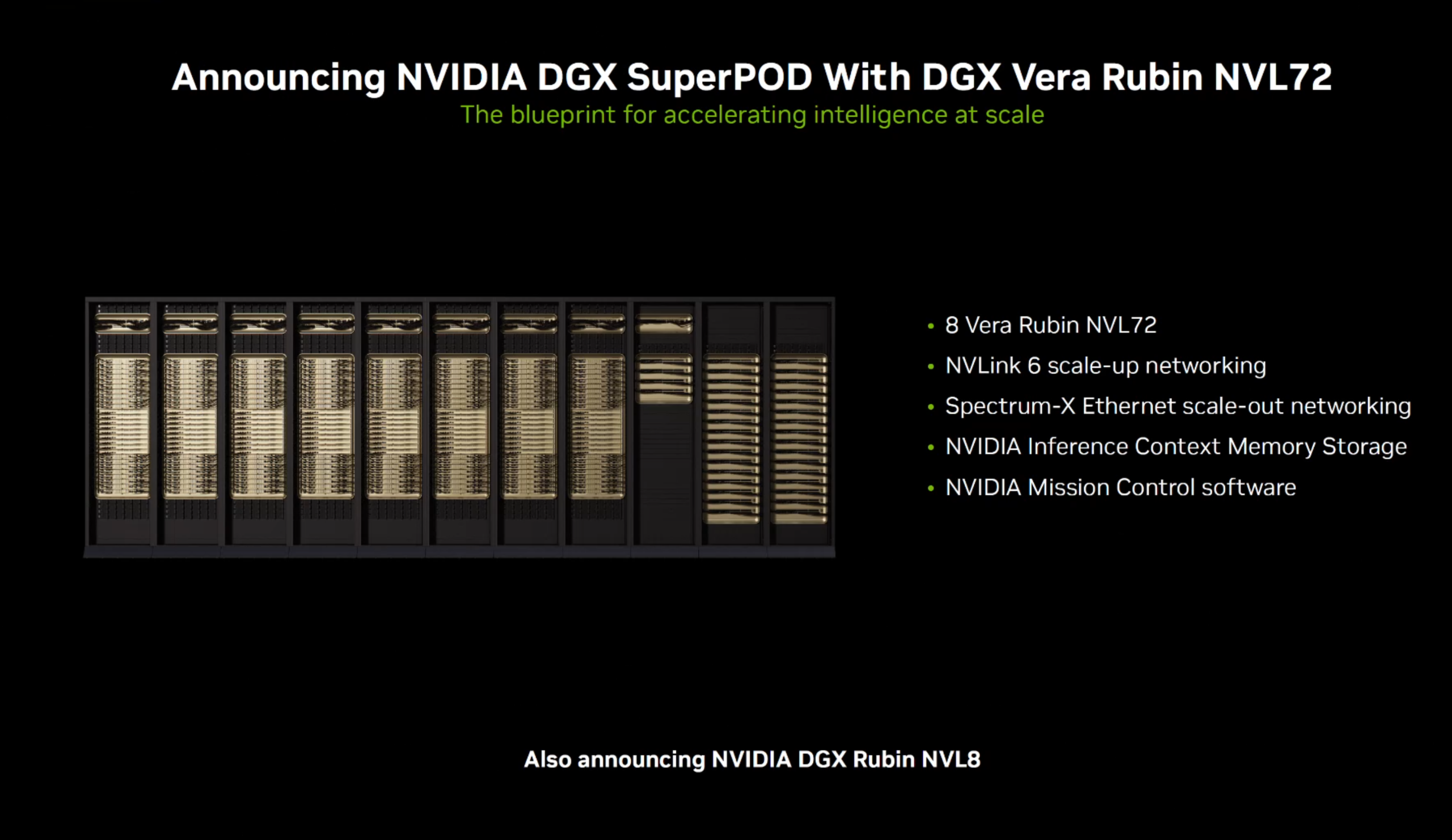

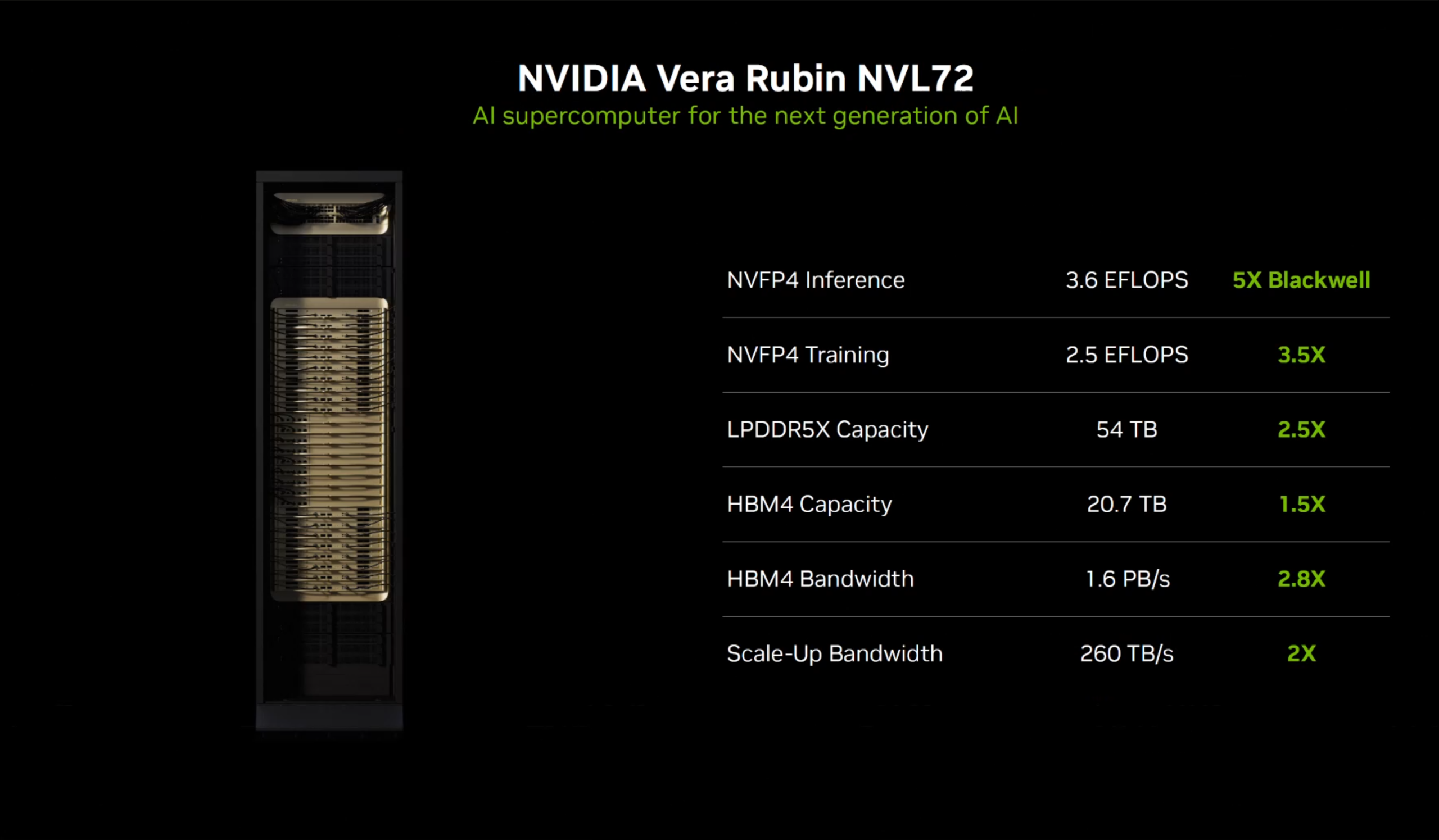

Wszystkie te komponenty łączą się w systemie Vera Rubin NVL72. To kompletna szafa rackowa, która działa jak jeden gigantyczny organizm. Dzięki przełącznikom NVLink 6. generacji, przepustowość wewnątrz systemu wynosi kosmiczne 260 TB/s. To więcej, niż przesyła cały globalny internet w danej sekundzie. Co ważne, NVIDIA rozwiązała problem plątaniny kabli i ciepła - system jest w pełni chłodzony cieczą, a modułowa konstrukcja eliminuje potrzebę ręcznego łączenia setek przewodów.

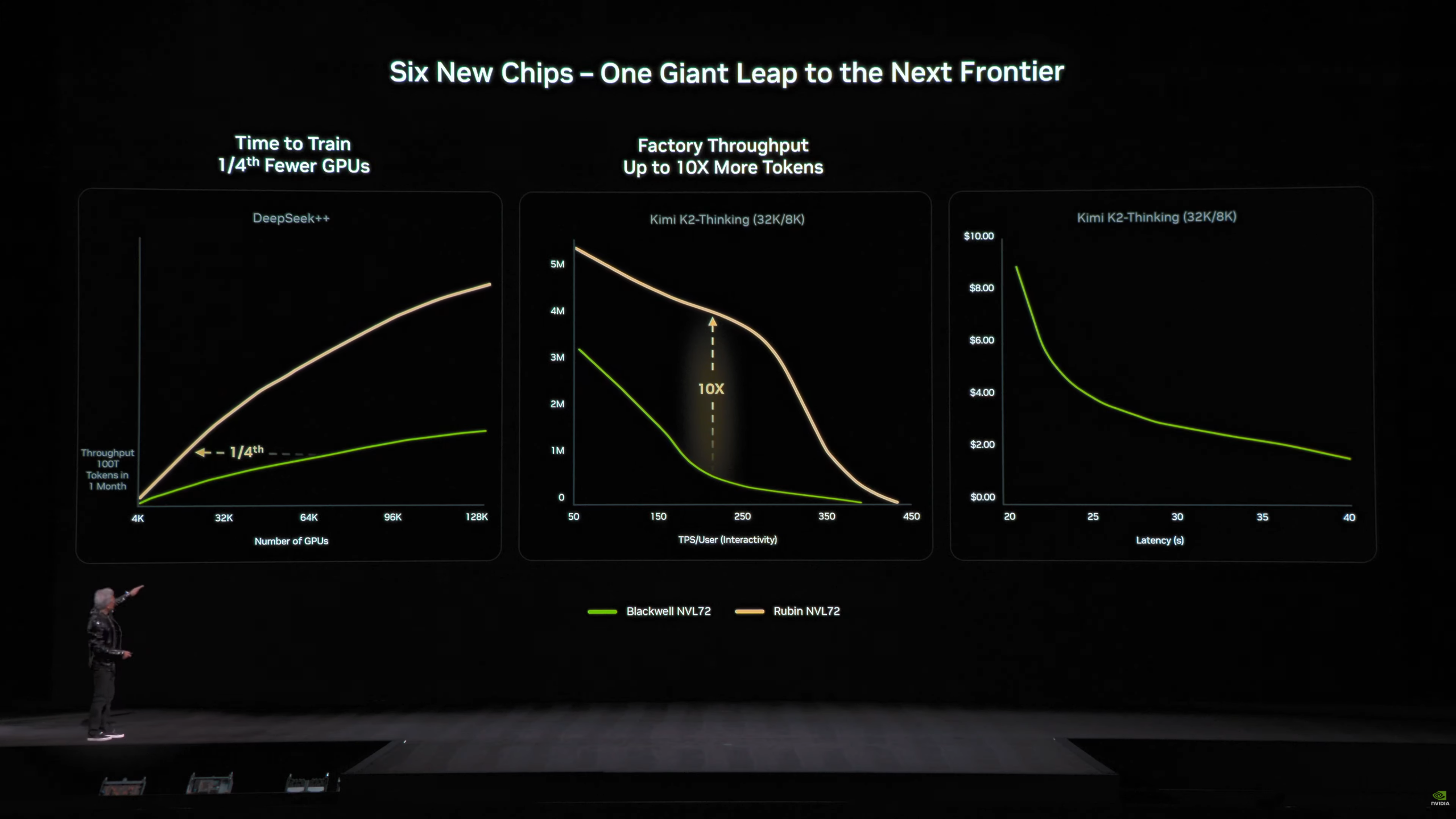

Liczby wyglądają spektakularnie:

- 5x wyższa wydajność we wnioskowaniu AI.

- 3,5x szybszy trening modeli.

- 10x niższy koszt generowania tokenów.

Podczas gdy konkurencja wciąż próbuje dogonić zeszłoroczne standardy, NVIDIA właśnie przesunęła linię mety o kilka długości boiska. Chipy są już w produkcji, a pierwsi klienci otrzymają systemy w drugiej połowie 2026 roku. Jensen w swojej skórzanej kurtce po raz kolejny udowodnił, że w tej branży kto nie biegnie sprintem, ten cofa się w rozwoju.

Nowe procesory NVIDIA zaprezentowane na CES 2026